System zarządzania ryzykiem AI: co wymaga artykuł 9 AI Act od firm

Artykuł 9 AI Act nakłada na dostawców systemów wysokiego ryzyka obowiązek posiadania udokumentowanego systemu zarządzania ryzykiem AI. Termin dla systemów z Załącznika III to 2 sierpnia 2026 — za mniej niż trzy miesiące. Brak systemu grozi karą do 15 mln euro lub 3% globalnego rocznego obrotu. W tym artykule znajdziesz cztery obowiązkowe etapy, wymagania dokumentacyjne i praktyczny plan wdrożenia zgodny z rozporządzeniem (UE) 2024/1689 (Komisja Europejska, 2024).

Czym jest system zarządzania ryzykiem AI w rozumieniu Art. 9 AI Act?

Art. 9 ust. 1 AI Act zobowiązuje dostawców systemów wysokiego ryzyka do ustanowienia, wdrożenia, udokumentowania i utrzymywania systemu zarządzania ryzykiem. Nie chodzi o jednorazowy dokument złożony do szuflady. Przepis wprost wymaga “ciągłego iteracyjnego procesu” prowadzonego przez cały cykl życia systemu AI (AI Act Explorer, 2025).

System zarządzania ryzykiem AI podlega regularnym przeglądom i aktualizacjom. Kluczowe jest słowo “ciągły” — regulacja wyklucza podejście “zrób raz i zapomnij”. Każda istotna zmiana systemu AI, danych treningowych lub kontekstu użycia wymaga ponownej oceny ryzyk i aktualizacji dokumentacji.

Kogo dotyczy obowiązek wdrożenia systemu zarządzania ryzykiem AI?

Obowiązek z Art. 9 dotyczy przede wszystkim dostawców — podmiotów opracowujących lub zlecających opracowanie systemu AI, który trafia na rynek UE pod ich nazwą. Ponadto podmiot stosujący (deployer) może ponosić analogiczne obowiązki, jeśli istotnie modyfikuje system lub stosuje go poza pierwotnym przeznaczeniem.

Do systemów wysokiego ryzyka (Załącznik III AI Act), które wymagają systemu zarządzania ryzykiem AI, zaliczają się m.in.:

- systemy AI stosowane w rekrutacji (ocena kandydatów, screening CV, shortlisting)

- systemy oceny zdolności kredytowej i scoringowe w finansach

- AI w edukacji (ocena egzaminów, rekrutacja do szkół, monitoring uczniów)

- systemy biometryczne stosowane w identyfikacji lub kategoryzacji osób

- AI w infrastrukturze krytycznej (energetyka, woda, transport)

- systemy AI wspomagające decyzje w wymiarze sprawiedliwości i administracji publicznej

Warto podkreślić: zakres podmiotowy nie ogranicza się do firm technologicznych. Polska firma produkcyjna używająca systemu AI do zarządzania dostępem pracowników jest podmiotem stosującym i może podlegać obowiązkom zarządzania ryzykiem.

Cztery obowiązkowe etapy systemu zarządzania ryzykiem AI według Art. 9 ust. 2

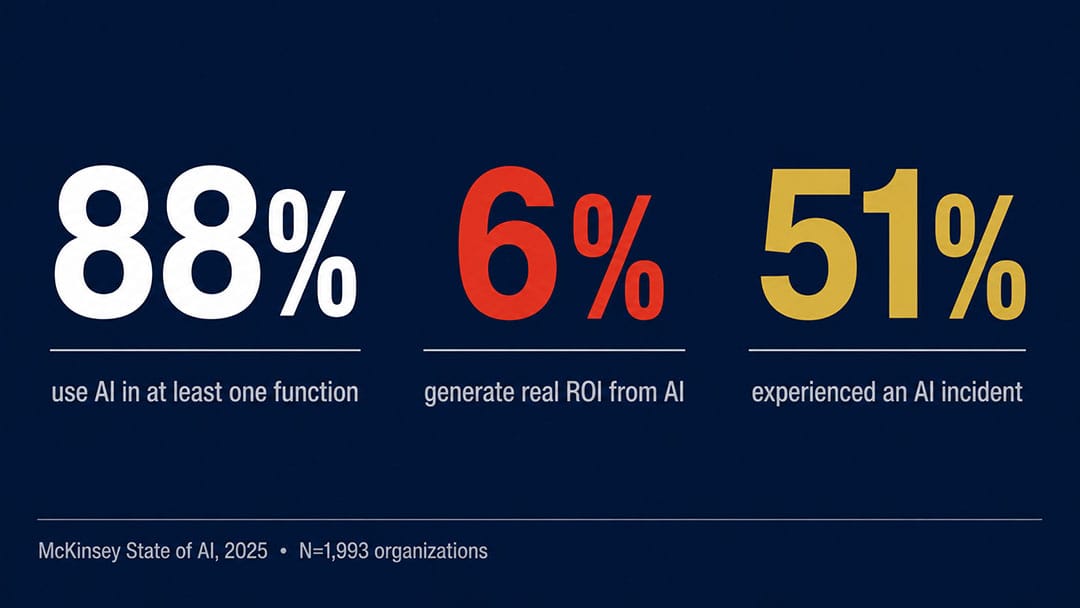

Art. 9 ust. 2 AI Act definiuje cztery działania, które musi obejmować każdy system zarządzania ryzykiem AI. Brak choćby jednego z nich stanowi naruszenie przepisów. [Raport instytucji międzynarodowej] Zgodnie z oficjalnym tekstem rozporządzenia (Komisja Europejska, 2024):

- Identyfikacja zagrożeń (Art. 9 ust. 2 lit. a) — wykrycie znanych i racjonalnie przewidywalnych zagrożeń dla zdrowia, bezpieczeństwa lub praw podstawowych wynikających z używania systemu AI.

- Ocena ryzyk (Art. 9 ust. 2 lit. b) — szacowanie ryzyk zarówno przy użytkowaniu zgodnym z przeznaczeniem, jak i przy “racjonalnie przewidywalnym nadużyciu” systemu.

- Monitoring post-marketowy (Art. 9 ust. 2 lit. c) — analiza danych zbieranych po wdrożeniu systemu (Art. 72 AI Act) w celu identyfikacji nowych ryzyk, które nie były widoczne przed wdrożeniem.

- Wdrożenie środków mitygacji (Art. 9 ust. 2 lit. d) — przyjęcie “odpowiednich i ukierunkowanych środków zarządzania ryzykiem” proporcjonalnych do zidentyfikowanych zagrożeń.

Powyższe etapy muszą być przeprowadzone przed wprowadzeniem systemu na rynek. Następnie powtarzane cyklicznie przez cały okres użytkowania systemu.

Jak przeprowadzić identyfikację ryzyka systemu AI?

Identyfikacja ryzyka to pierwszy i najważniejszy etap systemu zarządzania ryzykiem AI. Błąd na tym etapie skutkuje nieprawidłową oceną i nieadekwatną mitygacją. W praktyce identyfikacja obejmuje kilka obszarów analizy:

- Dane wejściowe — skąd pochodzą, jak są zbierane, czy mogą zawierać błędy lub bias

- Logika decyzyjna — jakie czynniki wpływają na wynik systemu i czy są one uzasadnione

- Grupy użytkowników i beneficjentów — kto podlega decyzjom systemu, kto jest narażony na negatywne skutki

- Scenariusze nadużycia — co się stanie, jeśli ktoś celowo poda błędne dane lub użyje systemu poza przeznaczeniem

- Grupy wrażliwe — Art. 9 ust. 9 wprost nakazuje uwzględnienie wpływu na osoby poniżej 18. roku życia i inne osoby wrażliwe

Wynikiem identyfikacji powinien być rejestr ryzyk — żywy dokument stanowiący fundament całej dokumentacji technicznej wymaganej przez Art. 11 AI Act. Rejestr musi wskazywać każde zagrożenie, jego źródło, prawdopodobieństwo wystąpienia i potencjalną dotkliwość skutków.

Testowanie systemów AI przed wdrożeniem — co wymaga Art. 9 ust. 6–8?

Art. 9 ust. 6–8 AI Act wprowadza obowiązek testowania systemów AI przed ich wprowadzeniem na rynek. Testy muszą spełniać trzy wymagania. Po pierwsze, muszą identyfikować odpowiednie środki zarządzania ryzykiem. Po drugie, muszą być przeprowadzane wobec z góry zdefiniowanych metryk i progów probabilistycznych. Po trzecie, muszą uwzględniać scenariusze nadużycia, a nie tylko użycia zgodnego z przeznaczeniem (AI Act Explorer, 2025).

Testowanie nie jest jednorazowe. Art. 9 wymaga ponownych testów po każdej istotnej zmianie systemu lub danych treningowych. Firma, która modyfikuje model AI — np. dostraja go na nowych danych lub zmienia architekturę — musi przeprowadzić pełny cykl testów od nowa.

Kluczowe jest udokumentowanie wyników testów. Protokoły testowe wchodzą w skład dokumentacji technicznej (Art. 11) i mogą być żądane przez organy nadzoru podczas inspekcji. Brak protokołów jest traktowany równoznacznie z brakiem testów.

System zarządzania ryzykiem AI a NIST AI RMF — porównanie podejść

Wiele firm pyta, czy wdrożenie NIST AI Risk Management Framework (wydany przez National Institute of Standards and Technology w janvier 2023 r.) spełnia wymogi Art. 9 AI Act. Odpowiedź jest częściowa. NIST AI RMF jest wartościowym narzędziem, które dobrze mapuje się na etapy Art. 9, ale nie zastępuje obowiązków wynikających z prawa UE.

Tabela porównawcza: NIST AI RMF a Art. 9 AI Act

| Kryterium | NIST AI RMF | Art. 9 AI Act |

|---|---|---|

| Charakter prawny | Dobrowolny framework | Obowiązkowe rozporządzenie UE |

| Zakres | Wszystkie systemy AI | Systemy wysokiego ryzyka (UE) |

| Kluczowe funkcje | GOVERN, MAP, MEASURE, MANAGE | Identyfikacja, ocena, monitoring, mitygacja |

| Dokumentacja | Zalecana | Obowiązkowa (Art. 11 AI Act) |

| Audyt zewnętrzny | Niewymagany | Wymagany dla niektórych sektorów (Art. 43) |

| Termin wdrożenia | Brak wiążącego terminu | 2 sierpnia 2026 (Załącznik III) |

| Kara za brak zgodności | Brak | Do 15 mln € lub 3% obrotu |

Firmy, które wdrożyły NIST AI RMF, mają solidną bazę — funkcja MAP odpowiada etapowi identyfikacji, MEASURE — ocenie ryzyk, MANAGE — mitygacji. Muszą jednak uzupełnić framework o obowiązkową dokumentację techniczną z Art. 11 oraz — tam gdzie jest to wymagane — o audyt przez jednostkę notyfikowaną (Art. 43).

Kary za brak systemu zarządzania ryzykiem AI

Brak udokumentowanego systemu zarządzania ryzykiem AI stanowi naruszenie obowiązków dostawcy. Podlega karze z Art. 99 ust. 4 AI Act: do 15 mln euro lub 3% globalnego rocznego obrotu — w zależności od tego, która kwota jest wyższa. Dla dużych przedsiębiorstw stosuje się wyższy z progów (Komisja Europejska, 2024).

Organy nadzorcze mają prawo żądać dokumentacji systemu zarządzania ryzykiem podczas inspekcji. Brak dokumentacji jest traktowany jako brak systemu — nawet jeśli firma faktycznie przeprowadzała oceny ryzyk. Dlatego dokumentowanie każdego etapu jest tak samo ważne jak samo wykonanie oceny.

Europejskie Biuro AI (EU AI Office) nadzoruje dodatkowo dostawców modeli ogólnego przeznaczenia (GPAI) i może nakładać kary niezależnie od krajowych organów nadzoru. W Polsce organem odpowiedzialnym za egzekucję AI Act ma być Komisja Rozwoju i Bezpieczeństwa Sztucznej Inteligencji, której powołanie przewiduje projekt ustawy Ministerstwa Cyfryzacji (Ministerstwo Cyfryzacji, 2025).

Jeśli chcesz zweryfikować gotowość swojej firmy, sprawdź nasz audyt zgodności z AI Act — oceniamy stan systemu zarządzania ryzykiem i identyfikujemy luki przed terminem egzekucji.

Co robi 230 firm UE — wnioski z AI Pact

Ponad 230 przedsiębiorstw z całej Europy podpisało dobrowolne zobowiązania w ramach AI Pact Komisji Europejskiej (stan na kwiecień 2026). Wśród trzech kluczowych zobowiązań znalazło się właśnie “identyfikowanie i mapowanie systemów AI, które mogą zostać sklasyfikowane jako wysokiego ryzyka” (Komisja Europejska, AI Pact, 2026).

Ponad połowa uczestników programu podjęła dodatkowe zobowiązania w zakresie nadzoru ludzkiego, mitygacji ryzyka i transparentności dotyczącej treści generowanej przez AI. Firmy, które przystąpiły do AI Pact wcześnie, traktują mapowanie systemów wysokiego ryzyka jako krok zerowy budowy systemu zarządzania ryzykiem. To de facto realizacja etapu identyfikacji z Art. 9 ust. 2 lit. a.

Jak wdrożyć system zarządzania ryzykiem AI w firmie — 5 kroków

Poniższy plan jest punktem wyjścia do zgodności z Art. 9. Poszczególne kroki należy dostosować do specyfiki systemu AI i sektora działalności.

- Inwentaryzacja systemów AI — sporządź kompletną listę systemów AI stosowanych w organizacji. Sprawdź, które wchodzą w zakres Załącznika III (systemy wysokiego ryzyka). Wyniki zapisz w rejestrze systemów AI.

- Wstępna ocena ryzyk — dla każdego systemu wysokiego ryzyka sporządź rejestr ryzyk. Uwzględnij scenariusze nadużycia, grupy wrażliwe (Art. 9 ust. 9) i potencjalne naruszenia praw podstawowych.

- Projektowanie środków mitygacji — do każdego zidentyfikowanego ryzyka przypisz konkretne środki zaradcze: ograniczenia funkcjonalne, mechanizmy nadzoru ludzkiego, filtry danych, procedury eskalacji.

- Testowanie i walidacja — przeprowadź testy przed wdrożeniem zgodnie z Art. 9 ust. 6–8. Zdefiniuj metryki, progi i scenariusze testowe. Udokumentuj wyniki w protokołach testowych.

- Dokumentacja techniczna i monitoring ciągły — przygotuj dokumentację techniczną (Art. 11), wdroż procedury monitorowania post-marketowego (Art. 72) i ustal harmonogram cyklicznych przeglądów systemu zarządzania ryzykiem.

Cały system musi być gotowy przed 2 sierpnia 2026 dla systemów z Załącznika III. Firmy z sektora finansowego, HR, edukacji i infrastruktury krytycznej powinny działać już teraz — budowa pełnej dokumentacji technicznej wymaga zwykle od 3 do 6 miesięcy. Zapoznaj się z naszą ofertą kompleksowego wdrożenia AI, która obejmuje m.in. przygotowanie systemu zarządzania ryzykiem.

Warto też zadbać o kompetencje wewnętrzne — szkolenia AI dla zespołu compliance i IT znacząco przyspieszają proces dokumentacji i obniżają ryzyko błędów w ocenie ryzyk.

Najczęściej zadawane pytania (FAQ)

Czy każda firma musi wdrożyć system zarządzania ryzykiem AI?

Nie każda. Obowiązek z Art. 9 dotyczy dostawców i podmiotów stosujących systemy AI wysokiego ryzyka z Załącznika III AI Act. Firmy używające wyłącznie systemów o minimalnym ryzyku — np. filtrów spamu, chatbotów rozrywkowych czy narzędzi do edycji tekstu — nie podlegają temu wymaganiu. Zaleca się jednak przeprowadzenie własnej inwentaryzacji i klasyfikacji systemów AI w organizacji.

Kiedy dokładnie wchodzi w życie Art. 9 AI Act dla firm?

Art. 9 obowiązuje od 2 sierpnia 2026 dla systemów wysokiego ryzyka z Załącznika III (24 miesiące od wejścia AI Act w życie w sierpniu 2024). Systemy z Załącznika I mają termin 36 miesięcy — do 2 sierpnia 2027. Systemy zakazane i niektóre wymogi GPAI obowiązują wcześniej — odpowiednio od lutego i sierpnia 2025.

Co to jest monitoring post-marketowy w systemie zarządzania ryzykiem AI?

To obowiązek zbierania i analizowania danych o działaniu systemu AI po jego wdrożeniu produkcyjnym. Dane te muszą zasilać aktualizacje oceny ryzyk — i prowadzić do modyfikacji lub wycofania systemu, jeśli pojawią się nowe zagrożenia. Szczegółowe wymagania dotyczące monitorowania reguluje Art. 72 AI Act. Dostawcy muszą posiadać udokumentowane procedury reagowania na incydenty.

Czy NIST AI RMF spełnia wymagania Art. 9 AI Act?

Częściowo. NIST AI RMF jest dobrowolnym frameworkiem, który strukturalnie pokrywa się z etapami Art. 9: funkcja MAP odpowiada identyfikacji, MEASURE — ocenie, MANAGE — mitygacji. Nie zastępuje jednak obowiązkowej dokumentacji technicznej z Art. 11 ani — tam gdzie jest wymagany — audytu przez jednostkę notyfikowaną (Art. 43). Firmy wdrażające NIST AI RMF mają solidną bazę, ale muszą uzupełnić ją o wymagania prawne AI Act.

Jaka kara grozi za brak systemu zarządzania ryzykiem AI?

Brak udokumentowanego systemu zarządzania ryzykiem AI lub brak jego aktualnej dokumentacji stanowi naruszenie Art. 9 AI Act. Podlega karze z Art. 99 ust. 4 — do 15 mln euro lub 3% globalnego rocznego obrotu, w zależności od tego, która kwota jest wyższa. Organy nadzorcze mogą żądać wglądu w dokumentację systemu zarządzania ryzykiem w trakcie inspekcji.

O autorze

Zespół ekspertów pcsid.pl — praktycy wdrożeń AI w firmach i instytucjach publicznych. Specjalizujemy się w audytach zgodności z AI Act, bezpiecznych wdrożeniach modeli LLM oraz programach szkoleniowych dla zespołów. Łączymy kompetencje techniczne (architektura systemów AI, MLOps) z prawnymi (RODO, AI Act) i procesowymi (zarządzanie zmianą).

Źródła

- [Raport instytucji międzynarodowej] European Commission (2024). Regulation (EU) 2024/1689 on Artificial Intelligence (AI Act), Article 9: Risk management system. Official Journal of the EU. https://eur-lex.europa.eu/eli/reg/2024/1689/oj

- [Raport instytucji międzynarodowej] AI Act Explorer (2025). Article 9: Risk Management System. Future of Life Institute. https://artificialintelligenceact.eu/article/9/

- [Raport instytucji międzynarodowej] European Commission (2026). AI Pact — voluntary pledges for AI Act compliance. Digital Strategy. https://digital-strategy.ec.europa.eu/en/policies/ai-pact

- [Raport instytucji międzynarodowej] European Commission (2025). Apply AI Strategy and EU AI Office. Digital Strategy. https://digital-strategy.ec.europa.eu/en/policies/ai-office

- [Raport instytucji międzynarodowej] National Institute of Standards and Technology (2023). Artificial Intelligence Risk Management Framework (AI RMF 1.0). NIST. https://www.nist.gov/itl/ai-risk-management-framework

- [Raport instytucji krajowej] Ministerstwo Cyfryzacji (2025). Projekt ustawy o systemach sztucznej inteligencji. https://www.gov.pl/web/cyfryzacja