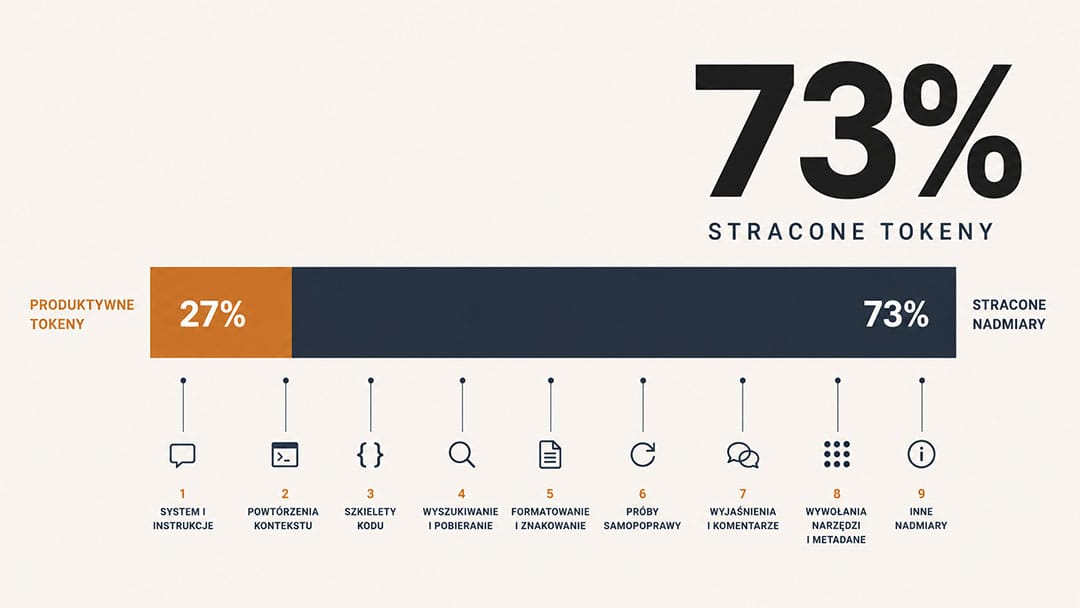

Optymalizacja Claude Code przestała być kwestią wygody — stała się finansową koniecznością. Przez 90 dni jeden z użytkowników Claude Code logował każdą sesję przez proxy HTTP między narzędziem a API Anthropic. Efekt: 430 godzin pracy, 6 milionów tokenów wejściowych, 1340 dolarów wydanych na API — i odkrycie, że zaledwie 27% tokenów wykonywało produktywną pracę. Pozostałe 73% pochłonęły dziewięć niewidocznych wzorców stosowanych automatycznie przez większość użytkowników. Każdy z nich ma 30-sekundową naprawę. Razem dają przeskok z 27% do ~65% produktywnych tokenów — bez zmiany modelu, bez rezygnacji z funkcji (@Mnilax, maj 2026).

Czym jest optymalizacja Claude Code i dlaczego 73% tokenów idzie w błoto?

Claude Code to narzędzie CLI Anthropic do pracy z kodem wspomaganej sztuczną inteligencją. W planach subskrypcyjnych (Pro, Max) tokeny są limitowane. W planach API — kosztują. Ale niezależnie od modelu rozliczenia obowiązuje ta sama zasada: każdy token wysłany do modelu zużywa fragment dostępnego limitu lub generuje koszt.

Problem w tym, że przed każdym właściwym pytaniem Claude Code ładuje szereg kontekstów: zasady z pliku CLAUDE.md, historię konwersacji, definicje narzędzi MCP, hooki, skille. Ten „podatek bazowy” rośnie z czasem i przy braku świadomego zarządzania pochłania 60–80% limitu zanim model przeczyta treść pytania. Antropic przyznał w marcu 2026 roku, że „użytkownicy wyczerpują limity Claude Code znacznie szybciej niż oczekiwano” — subskrybenci planu Max 5 raportowali wyczerpanie limitu w 19 minut zamiast oczekiwanych 5 godzin. Użytkownicy planu Pro podawali, że limit kończy się co poniedziałek, reset następuje w sobotę — efektywnie 12 dni użytkowania z 30. Część problemu leżała po stronie Anthropic (dwa niezależne błędy w warstwie cache’owania, ujawnione przez GitHub issue #40524, inflowały koszty o 10–20× w niektórych sesjach). Błąd załatano. Jednak analiza 430 godzin pokazała, że większość marnotrawstwa pochodzi od samych użytkowników.

Metodologia: jak zmierzyć marnotrawstwo tokenów w Claude Code?

Analityk uruchomił proxy HTTP między Claude Code a API Anthropic i logował każde żądanie przez 90 dni. Każdy request zawierał pełny payload, odpowiedź, liczby tokenów (input / output / cache), czas odpowiedzi i model. Tokeny dzielone były na kategorie:

- Produktywne — treść bezpośrednio odpowiadająca na zadanie

- Cache hit (bezpłatne) — system prompt i CLAUDE.md z cache, bez dodatkowego kosztu

- Cache miss (płatne) — ta sama treść przeliczona od nowa, bo cache wygasł

- Historia konwersacji — przetokenizowanie poprzednich wiadomości przy każdej turze

- Hook injection — kontekst wstrzykiwany przez hooki UserPromptSubmit

- Skill loading — zawartość SKILL.md przy wywołaniu skilla

- Definicje narzędzi MCP — schematy JSON przy każdym żądaniu

- Extended thinking — bloki <thinking> generowane przez model

Wynik: 27% tokenów produktywnych. 73% to dziewięć wzorców poniżej, uszeregowanych według kosztu. Ta metodologia pozwala precyzyjnie zidentyfikować, gdzie optymalizacja Claude Code przyniesie największy zwrot — bez domysłów, na podstawie danych z prawdziwych sesji.

Wzorzec 1 i 2: CLAUDE.md i historia konwersacji — 27% tokenów Claude Code

Wzorzec 1: CLAUDE.md bloat (~14% tokenów)

Plik CLAUDE.md zawiera reguły projektu ładowane przy każdej turze. Problemem jest jego rosnąca objętość: plik analizowanego użytkownika urósł do 4800 tokenów w ciągu 6 miesięcy użytkowania. Każde żądanie płaci ten koszt z góry — 5000 tokenów zanim wpisze się pierwsze słowo. Przy 200 turach tygodniowo to milion tokenów tygodniowo samego CLAUDE.md.

Naprawa w 30 sekund: sprawdź rozmiar pliku poleceniem wc -w ~/.claude/CLAUDE.md oraz wc -w .claude/CLAUDE.md. Cel: łącznie poniżej 1200 słów (~1500 tokenów). Przenieś reguły specyficzne dla frameworku do CLAUDE.md na poziomie projektu, wyciągnij powtarzające się wzorce do skilli, usuń wszystko, czego nie pamiętasz po co pisałeś, skróć „wyjaśnienia dlaczego” do trzywyrazowych imperatywów. Efekt: redukcja z 4800 do 900 tokenów dała 31% spadek kosztu bazowego, natychmiastowo.

Wzorzec 2: historia konwersacji re-read (~13% tokenów)

Każda kolejna wiadomość przetokenizowuje całą historię konwersacji. Przy ~500 tokenach na wymianę wiadomość numer 30 kosztuje 30-krotność ceny pierwszej. Analiza wykazała sesje z ponad 60 wiadomościami — ostatnie wiadomości kosztowały 60× więcej niż pierwsza.

Naprawa w 30 sekund: edytuj poprzednią wiadomość zamiast pisać follow-up (strzałka w górę → edycja → ponowne wysłanie). Nałóż twardy limit 20 wiadomości na sesję. Po przekroczeniu poproś Claude o podsumowanie i zacznij nową sesję z tym podsumowaniem jako pierwszą wiadomością. Używaj /compact zamiast /clear — compact streszcza i restartuje, clear niszczy kontekst. Efekt: redukcja średniej sesji z 60 do 15 wiadomości dała 40% spadek kosztów re-read.

Wzorzec 3 i 4: Hooki i cache miss — 21% tokenów

Wzorzec 3: Hook injection (~11% tokenów)

Hooki UserPromptSubmit wstrzykują kontekst przed każdym promptem — gałąź git, ostatnie zmiany plików, podsumowania pamięci. Każdy hook jest mały. Cztery razem dały 6200 tokenów wstrzyknięcia na każdy prompt zanim Claude przeczytał pytanie.

Naprawa w 30 sekund: sprawdź co jest wstrzykiwane poleceniem cat ~/.claude/settings.json | jq ’.hooks.UserPromptSubmit’. Wyłącz każdy hook, którego nie jesteś w stanie uzasadnić konkretnym zadaniem. Redukcja z 4 aktywnych hooków do 1 (tylko gałąź git) dała 5800 tokenów zaoszczędzonych na każdy prompt.

Wzorzec 4: Cache miss przy wznawianiu sesji (~10% tokenów)

Prompt cache Anthropic ma domyślnie 5-minutowy czas życia. Przerwa na kawę powyżej 6 minut oznacza cache miss: system prompt, CLAUDE.md i schematy narzędzi przeliczają się od nowa w pełnej cenie zamiast 10% (cena odczytu z cache). W 90-dniowej analizie takich wznowień było ~640.

Szybka naprawa: przypisz skrót klawiszowy do dowolnego krótkiego promptu i wyślij go w ciągu 4 minut, jeśli planujesz przerwę — utrzyma cache ciepłym. Naprawa docelowa: przejdź na 1-godzinny czas życia cache w płatnych planach. Tokeny zapisu cache kosztują 2× cenę bazową (jednorazowo przy pierwszym zapisie), odczyt cache to 0,1× ceny bazowej. Jeśli masz ponad 10 wznowień na sesję, matematyka jest po stronie godzinowego cache. Efekt: 80% redukcji kosztu cache miss.

Wzorzec 5 i 6: Skille i MCP — 13% tokenów Claude Code

Wzorzec 5: Skill loading na nieistotnych zadaniach (~7% tokenów)

Każdy zainstalowany skill ładuje swój plik SKILL.md automatycznie, gdy Claude wykryje „potencjalną istotność” — prg detekcji jest konserwatywny: wątpliwe = załaduj. Przy 9 zainstalowanych skillach i średnim rozmiarze 800–2500 tokenów każdy, daje to łącznie 9 × ~1500 tokenów = 13 500 tokenów narzutu na zadanie, które żadnego z nich nie wymaga. Skill do projektowania UI ładował się przy zadaniach backendowych. Skill do generowania wideo — przy pracy z tekstem.

Naprawa: przeprowadź 7-dniowy audyt. Które skille faktycznie wywołałeś? Wyłącz wszystko pozostałe. Redukcja z 11 do 4 aktywnych skilli dała 9000+ tokenów zaoszczędzonych na zadanie.

Wzorzec 6: „Na wszelki wypadek” — definicje narzędzi MCP (~6% tokenów)

Każdy podłączony serwer MCP (Model Context Protocol) dostarcza schemat swoich narzędzi do każdego żądania — niezależnie od tego, czy zadanie wymaga danego narzędzia. Serwer PostgreSQL MCP to ~1200 tokenów samego schematu. Przy 12 serwerach MCP i średnio ~600 tokenach schematu na serwer: 12 × 600 = 7200 tokenów definicji narzędzi przy każdym żądaniu. W rzeczywistości 3 z 12 MCP pokrywały 80% pracy.

Naprawa: uruchom /mcp by wylistować serwery, /mcp disable <nazwa> by wyłączyć zbędne na bieżącą sesję. Usuń nieużywane MCP z auto-load w pliku ~/.claude/settings.json — włączaj je per-sesję gdy naprawdę potrzebujesz. Redukcja z 12 do 3 zawsze aktywnych MCP: 6000 tokenów zaoszczędzonych na każde żądanie.

Wzorzec 7, 8 i 9: Extended thinking i auto-update — 12% tokenów

Wzorzec 7: Extended thinking na prostych pytaniach (~5% tokenów)

„Advanced Thinking” włączone globalnie sprawia, że Claude spala 3000+ tokenów bloków <thinking> na pytania, które nie wymagają rozumowania — np. „zmień nazwę zmiennej na camelCase”. Extended thinking ma realną wartość przy decyzjach architektonicznych i złożonym debugowaniu. Na prostych zadaniach to czysty narzut.

Naprawa: wyłącz extended thinking domyślnie. Włączaj per-wiadomość skrótem Alt+T w Claude Code gdy zadanie naprawdę tego wymaga. Około 80% zadań nie potrzebuje extended thinking — te 20%, przy których je potrzebujesz, rozpoznasz natychmiast.

Wzorzec 8: Generowanie w złym kierunku (~4% tokenów)

Claude zaczyna pisać odpowiedź o długości 400 linii. Po 50 liniach widać, że idzie w złą stronę. Większość użytkowników czeka na zakończenie, po czym pisze nowy prompt. Pozostałe 350 linii to zmarnowane tokeny wyjściowe — a tokeny wyjściowe są rozliczane. Szacunkowy koszt tej „głupiej daniny”: ~15 dolarów miesięcznie.

Naprawa: Cmd+. (Mac) lub Ctrl+. natychmiast zatrzymuje generowanie. Claude zachowuje to, co już napisał — przekierowujesz od tego miejsca. Trenuj odruch używania go w ciągu pierwszych 5 sekund dryfującej odpowiedzi. W terminalu Claude Code podwójny Esc otwiera scroller checkpointów — możesz cofnąć się do dowolnego poprzedniego stanu bez ponownego uruchamiania.

Wzorzec 9: Plugin auto-update redundancy (~3% tokenów)

Pluginy auto-aktualizują się przy starcie sesji i mogą dodawać komunikaty do hooków SessionStart. Przy 9 pluginach i wielu komunikatach „loaded successfully” na każdy, efekt to ~1400 tokenów wyłącznie na potwierdzenia załadowania — przy każdym starcie sesji.

Naprawa: sprawdź hooki startowe poleceniem cat ~/.claude/settings.json | jq ’.hooks.SessionStart’. Wyłącz każdy hook służący wyłącznie do powiadamiania „loaded”. Redukcja z 9 do 2 hooków SessionStart (jeden dla kontekstu gałęzi, jeden dla zmiennych środowiskowych): 1200 tokenów zaoszczędzonych przy każdym starcie sesji.

Tabela: 9 wzorców marnotrawstwa i ich wpływ na optymalizację Claude Code

| Wzorzec | Udział w stratach | Typowy koszt bez naprawy | Naprawa | Efekt po naprawie |

|---|---|---|---|---|

| 1. CLAUDE.md bloat | ~14% | 5000 tok. na każdą turę | Skróć do <1200 słów | −31% kosztu bazowego |

| 2. Historia konwersacji | ~13% | 30× cena przy 30. wiad. | Limit 20 wiad., /compact | −40% kosztu re-read |

| 3. Hook injection | ~11% | 6200 tok. na każdy prompt | Ogranicz do 1 hooka | −5800 tok. na prompt |

| 4. Cache miss | ~10% | Pełna cena ~8K tok. po 5 min | Ping co 4 min lub cache 1h | −80% kosztu cache miss |

| 5. Skill loading | ~7% | 13 500 tok. na zadanie | 4 skille zamiast 11 | −9000 tok. na zadanie |

| 6. MCP tool definitions | ~6% | 7200 tok. na żądanie | 3 MCP zamiast 12 | −6000 tok. na żądanie |

| 7. Extended thinking | ~5% | 3000+ tok. na proste zadanie | Domyślnie OFF, Alt+T per msg | Oszczędność na 80% zadań |

| 8. Złe generowanie | ~4% | ~$15 mies. (tokeny output) | Cmd+. lub Ctrl+. stop | ~$15/mies. odzyskane |

| 9. Plugin auto-update | ~3% | 1400 tok. na start sesji | 2 SessionStart hooki | −1200 tok. na sesję |

Wynik łączny: produktywny udział tokenów wzrósł z 27% do ~65% po wdrożeniu wszystkich napraw. To przesunięcie jest możliwe wyłącznie przez optymalizację Claude Code na poziomie konfiguracji sesji — nie przez zmianę modelu ani planu subskrypcyjnego.

Skrypt audytu — jak sprawdzić optymalizację Claude Code samodzielnie

Poniższy skrypt bash flaguje wszystkie 9 wzorców w jednym uruchomieniu. Uruchom go w katalogu projektu i sprawdź, które linie są poza celem:

#!/bin/bash — claude-audit.sh

echo „=== CLAUDE.md size ===”

wc -w ~/.claude/CLAUDE.md 2>/dev/null

wc -w .claude/CLAUDE.md 2>/dev/null

echo „Cel: łącznie < 1200 słów”echo „=== Aktywne hooki ===”

cat ~/.claude/settings.json 2>/dev/null | jq ’.hooks // {} | keys’echo „=== UserPromptSubmit injections ===”

cat ~/.claude/settings.json 2>/dev/null | jq ’.hooks.UserPromptSubmit’echo „=== Zainstalowane skille ===”

ls ~/.claude/skills/ 2>/dev/null

echo „Cel: 3–5 aktywnych”echo „=== Podłączone MCP ===”

cat ~/.claude/settings.json 2>/dev/null | jq ’.mcpServers // {} | keys’

echo „Cel: 3 zawsze aktywne”echo „=== SessionStart hooks ===”

cat ~/.claude/settings.json 2>/dev/null | jq ’.hooks.SessionStart’

Uruchamiaj skrypt co tydzień przez minimum 4 tygodnie. Każda pozycja poza celem to konkretna pula tokenów do odzyskania. Po 4 tygodniach cotygodniowych korekt wszystkie wskaźniki powinny być w celu i tam pozostać — a optymalizacja Claude Code staje się nawykiem, nie jednorazową akcją.

Jeśli Twój zespół korzysta z Claude Code przy projektach AI i szukasz sposobu na ustrukturyzowanie tej wiedzy — program szkoleniowy AI dla biznesu obejmuje praktyczne aspekty optymalizacji narzędzi AI, zarządzania kosztami API i budowania standardów pracy z modelami językowymi.

Co nie działa — mity o optymalizacji Claude Code

Optymalizacja Claude Code budzi kilka mitów. Analiza 430 godzin przetestowała standardowe porady z blogów i obaliła te, które nie działają:

- Przełączanie na Haiku dla prostych zadań: ~3% redukcji kosztów. Tańszy model na napuchniętym kontekście nadal kosztuje więcej niż drogi model na odchudzonym kontekście. Kontekst, nie model, jest główną zmienną.

- Agresywne /clear między każdym zadaniem: kontrproduktywne. Utrata kontekstu, który był potrzebny. Lepsza strategia: długa sesja per projekt z instrumentowanymi hookami i szczupłym CLAUDE.md.

- Wyłączenie wszystkich skilli: początkowo oszczędza tokeny, następnie użytkownik zaczyna wpisywać te same 200-tokenowe instrukcje ręcznie w każdym prompcie. Wynik netto negatywny.

- Praca w godzinach poza szczytem: redukcja quota w godzinach szczytu dotyczy ok. 7% użytkowników. Dla większości główna dźwignia to wzorce powyżej, nie pora dnia.

- Downgrade planu subskrypcyjnego: nie rozwiązuje problemu. Koszt na godzinę pracy pozostaje taki sam, limity są bardziej dotkliwe.

Dla firm wdrażających AI narzędzia i potrzebujących kontroli nad kosztami i procesami — bezpieczne wdrożenie AI w firmie obejmuje zarówno aspekty techniczne (zarządzanie dostępem do API, kontrola kosztów modeli), jak i procesowe (polityki użytkowania, standardy dla zespołów).

Najczęściej zadawane pytania (FAQ)

Dlaczego limity Claude Code wyczerpują się tak szybko?

Główna przyczyna to narzut kontekstowy: CLAUDE.md, hooki UserPromptSubmit, definicje narzędzi MCP i historia konwersacji pochłaniają tokeny zanim model przeczyta właściwy prompt. Empiryczna analiza 430 godzin pokazuje, że w nieskonfigurowanej instalacji Claude Code tylko 27% tokenów trafia do produktywnego generowania — reszta to podatek bazowy od infrastruktury sesji, który rośnie z każdym dodanym pluginem i skrótem.

Czy błąd cache Claude Code z marca 2026 jest już naprawiony?

Tak — Anthropic załatał dwa niezależne błędy w warstwie cache’owania (GitHub issue #40524). Błędy cicho inflowały koszty o 10–20× w niektórych sesjach. Tymczasowym obejściem był downgrade do v2.1.34. Aktualna wersja Claude Code nie ma tego problemu. Jeśli nadal wyczerpujesz limity szybciej niż oczekujesz, przyczyną są wzorce opisane w tym artykule, nie błąd cache.

Jak szybko działa optymalizacja Claude Code po wprowadzeniu napraw?

Natychmiastowo — od następnej sesji. Redukcja CLAUDE.md, wyłączenie hooków i ograniczenie liczby aktywnych MCP to zmiany w plikach konfiguracyjnych bez restartu. Efekty łączne (wzrost produktywności tokenów z 27% do ~65%) są mierzalne już pierwszego dnia. Wyniki utrzymują się, jeśli skrypt audytu uruchamiany jest co tydzień przez pierwsze 4 tygodnie.

Czy optymalizacje działają na planie Pro, a nie tylko Max?

Tak — wszystkie 9 wzorców dotyczy każdego planu Claude Code, ponieważ wynikają ze sposobu zarządzania kontekstem, nie z poziomu planu. Użytkownicy Pro raportowali wyczerpanie limitu każdego poniedziałku, reset w sobotę — faktycznie 12 dni użytkowania z 30. Optymalizacja kontekstu poprawia sytuację niezależnie od planu subskrypcyjnego.

Skąd wiadomo, które skille faktycznie używam?

Przeszukaj logi Claude Code poleceniem: grep -h „skill_invoked” ~/.claude/logs/*.log | sort | uniq -c | sort -rn. Skille niewidoczne w wynikach przez ostatnie 7 dni to kandydaci do wyłączenia. Analiza 90 dni wykazała, że z 11 zainstalowanych skilli tylko 4 były faktycznie wywoływane — pozostałe 7 generowało narzut przy każdym zadaniu.

O autorze

Zespół ekspertów pcsid.pl — praktycy wdrożeń AI w firmach i instytucjach publicznych. Specjalizujemy się w audytach zgodności z AI Act, bezpiecznych wdrożeniach modeli LLM oraz programach szkoleniowych dla zespołów. Łączymy kompetencje techniczne (architektura systemów AI, MLOps) z prawnymi (RODO, AI Act) i procesowymi (zarządzanie zmianą).

Źródła

- @Mnilax (2026, maj). I tracked 430 hours of Claude Code usage. 73% was wasted on these 9 patterns. X (Twitter). https://x.com/Mnilax/status/2050261839653556522 [dostęp: 2026-05-09]. [Analiza empiryczna — 90 dni logów przez proxy HTTP; dane nieopublikowane recenzyjnie]

- Anthropic (2026, marzec). Oświadczenie o limitach Claude Code i błędzie cache — GitHub issue #40524. Anthropic / GitHub. Referencja z analizy @Mnilax (2026). [Oświadczenie firmy]

- Anthropic (2025). Claude Code — dokumentacja techniczna i prompt caching. Anthropic. https://docs.anthropic.com/ [dostęp: 2026-05-09]. [Dokumentacja techniczna producenta]